近年、スポーツにおけるデータ分析が盛んになっており、特に試合中のプレーを認識することは戦術構築をする上で重要な役割を果たします。例えば、どこからシュートを打ってどれくらい成功したかといった画像のようなシュートチャートが得られると、どの方向から相手をブロックすべきかが変わります。しかし、分析のためには日々の練習や試合のデータを収集し続けることが重要であり、ここでラベリングの手間が問題になります。したがってラベリング自動化のために、本研究では試合中のアクション認識を行うことを目指します。

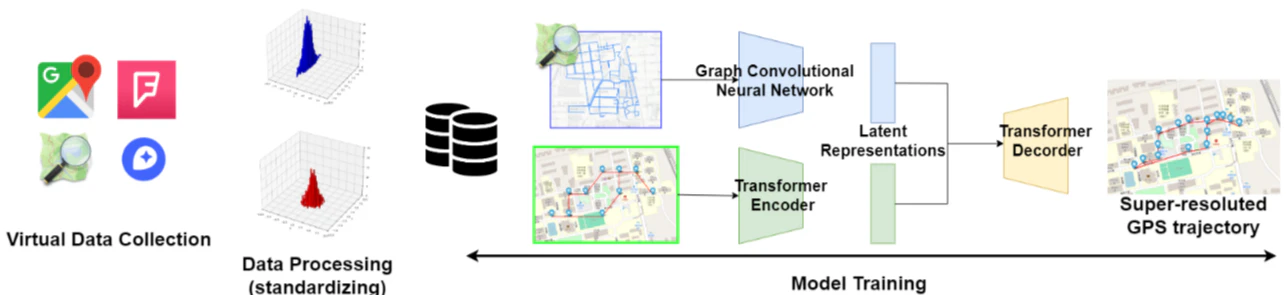

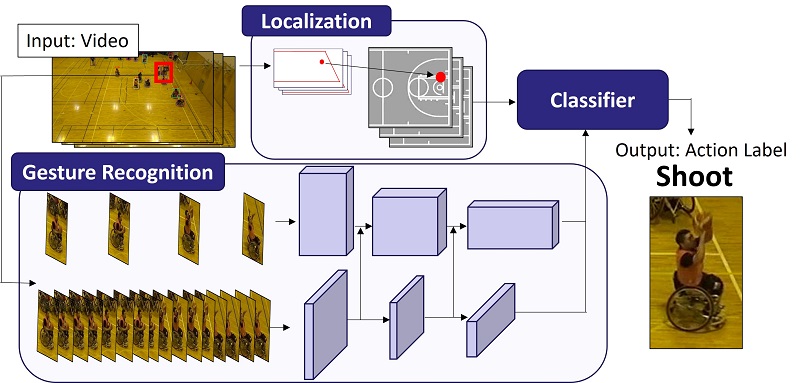

選手の行動判断の材料には選手の位置や方向,移動の速度といったコートを中心とした動きが含まれると考え、この位置情報を考慮した行動認識モデルの設計を行います。

例えば、バスケットボールにおいてボールを保持しているとき、その選手が自陣にいるか、ハーフライン付近にいるか、ゴールの下にいるかでは、行動の優先順位が大きく変わると考えられます。ゴールから遠くなるほど、パスやドリブルの優先順位が上がり、シュートの選択はされにくいと考えられます。映像データを入力として、まず位置推定を行い位置特徴量の抽出を行います。

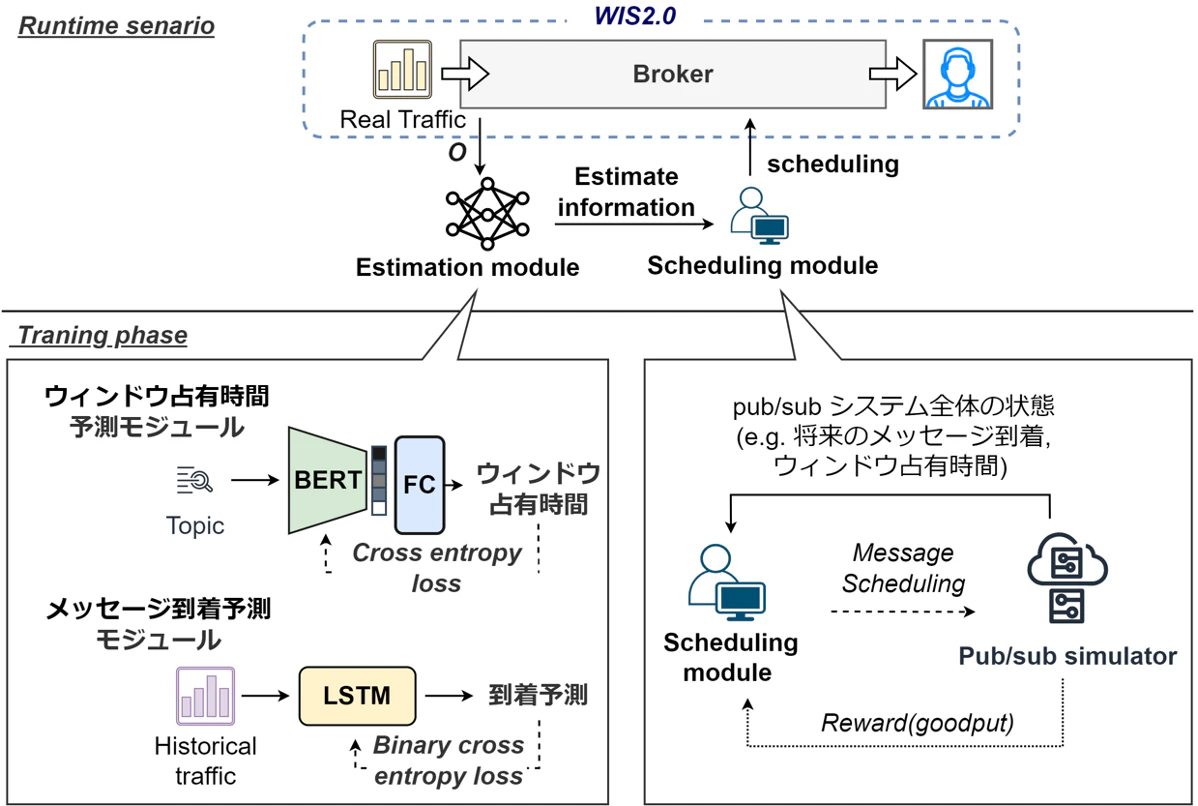

次に、位置推定と並行して既存の行動認識モデルを用いて人物中心の動きを認識します。人物中心の動きを認識するため、これをジェスチャー認識モデルとしてわれわれは考えます。最後にこれらの出力を合わせて分類器にかけ最終的なクラスの出力を行います。

関連論文

- Ryosuke Hasegawa, Akira Uchiyama, Fumio Okura, Daigo Muramatsu, Issei Ogasawara, Hiromi Takahata, Ken Nakata, and Teruo Higashino, "Close-Contact Detection Using a Single Camera for Sports Considering Occlusion", IEEE Access, Vol. 10, pp.15457-15468, 2022